Indflyvning til Sprogmodeller

Denne side er tilpasset til nybegyndere der skal forstå hvad sprogmodeller er og hvordan de virker.

🎯 Vores Tilgang: Start med Problemet, Ikke Teknologien

McKinsey-princippet: “Start med problemet, tænk på teknologien bagefter”

Vi starter ikke med teknologien, men med jeres problematik og hvordan AI kan hjælpe jer med at løse den. Derefter lærer vi teknologien.

McKinsey & Company: I deres artikel “In digital and AI transformations, start with the problem, not the technology” understreger de vigtigheden af at starte med problemet, ikke teknologien.

Hvad betyder det for jer?

I stedet for at spørge “Hvilken AI-model skal vi bruge?”, starter vi med:

- Hvad er problemet? - One-liners i GitHub Issues

- Hvad koster det? - “Ping-pong” spørgsmål, forsinket udvikling

- Hvordan løser vi det? - AI kan kvalificere one-liners

- Hvilken teknologi? - PPG og prompts som værktøj

Læring: Fokus på værdi og problemløsning, ikke teknologi for teknologis skyld.

🎯 Hvad I Vil Have - Fra Nybegyndere til Konkret Brug

For Nybegyndere

- Introduktion til Prompts - Hvad er en prompt? Hvordan skriver man en god prompt?

- Grundlæggende forståelse - Hvad er sprogmodeller? Hvad kan de og ikke kan?

- Praktiske eksempler - Se det i aktion med jeres egne one-liners

Konkret om PPG’en

- PPG (Personlig Prompt Guide) - En struktureret guide til at kvalificere ændringsønsker

- Problematik-først tilgang - Start med problemet, ikke teknologien

- Feedback-loop - Kontinuerlig forbedring gennem GitHub versionsstyring

Problematik som Udgangspunkt

Vi tager udgangspunkt i jeres konkrete problematik:

- One-liners i GitHub Issues

- Manglende struktur i ændringsønsker

- “Ping-pong” spørgsmål mellem forretning og udvikling

Løsningen: AI + PPG til at kvalificere one-liners → Kvalificerede ændringsønsker

Hvad er en Sprogmodel?

En sprogmodel er en AI der er trænet på enorme mængder tekst. Den kan:

- Forstå sprog

- Generere tekst

- Svare på spørgsmål

- Oversætte

- Summarisere

Men vigtigt: Den er IKKE en fakta-database som Google. Den er en probabilistisk model - den gætter baseret på sandsynlighed.

Hvordan Virker Det?

Træning

- Modellen læser milliarder af sider tekst

- Den lærer mønstre i sprog

- Den lærer sammenhænge mellem ord og begreber

Brug

- Du giver modellen en prompt (spørgsmål/instruktion)

- Modellen gætter det mest sandsynlige næste ord

- Den fortsætter ord for ord

- Resultatet er et svar

Vigtigt: Modellen “gætter” - den ved ikke om det er korrekt. Den ved kun hvad der er mest sandsynligt baseret på træningen.

Hvad Kan de og Ikke Kan?

✅ Hvad de KAN:

- Generere tekst baseret på mønstre

- Forstå kontekst (jo mere kontekst, jo bedre)

- Oversætte mellem sprog

- Summarisere lange tekster

- Svare på spørgsmål (hvis de har set lignende før)

- Kode (hvis de er trænet på kode)

❌ Hvad de IKKE kan:

- Faktatjek (de gætter, ikke søger)

- Real-time information (kun træningsdata)

- Matematik uden fejl (de gætter, ikke regner)

- Garanteret korrekt svar (de kan finde på ting)

- Erstatte faglighed (de ved ikke om svaret er korrekt)

Demonstrere Temperatur

Temperatur er en indstilling der styrer hvor “kreativ” modellen er:

- Lav temperatur (0.1-0.3): Konservativ, præcis, mindre variation

- Høj temperatur (0.7-1.0): Kreativ, varieret, mere usikker

Eksempel:

- Lav temperatur: “Hvad er 2+2?” → “4” (altid samme svar)

- Høj temperatur: “Skriv en kreativ historie” → Forskellige historier hver gang

Til change requests: Brug lav temperatur (0.2-0.3) for præcise, konsistente svar.

Demonstrere Capabilities

Kontekst-længde

- ChatGPT 3.5: ~4.000 tokens (ca. 3.000 ord)

- ChatGPT 4: ~8.000 tokens (ca. 6.000 ord)

- Claude: ~100.000 tokens (ca. 75.000 ord)

Betydning: Jo længere kontekst, jo mere kan modellen huske i samme samtale.

Multimodal

- ChatGPT: Tekst + billeder (i nogle versioner)

- Gemini: Tekst + billeder + video

- Claude: Tekst + billeder

Betydning: Nogle modeller kan analysere billeder, ikke kun tekst.

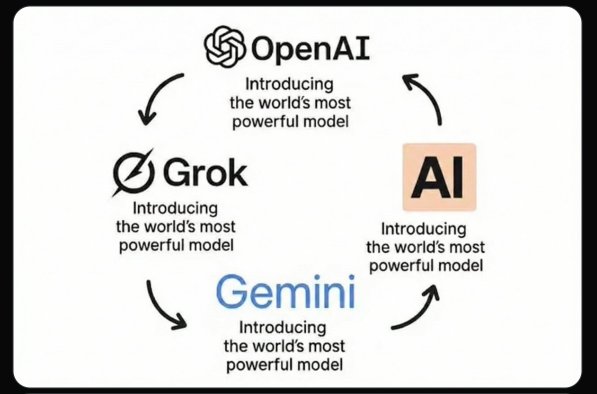

De 4 Store AI Modeller

Der findes mange forskellige AI-modeller, men de 4 mest populære er:

- Gemini (Google)

- Claude (Anthropic)

- ChatGPT (OpenAI)

- Grok (xAI)

Hver model tilbyder både hurtige og dybtænkende versioner:

- Fast: Hurtige svar, ideelt til simple opgaver

- Tænkende: Dybere analyse, bedre til komplekse opgaver

Vigtigt at huske: Hver AI-virksomhed påstår at have “verdens mest kraftfulde model”. Dette diagram viser den konkurrerende markedsføring i AI-industrien:

Læring: Fokusér ikke på hvilken model der er “mest kraftfuld”, men på hvilken model der løser jeres problem bedst. Husk McKinsey-princippet: “Start med problemet, tænk på teknologien bagefter.”

Introduktion til Prompts - For Nybegyndere

Hvad er en Prompt?

En prompt er den tekst du skriver til AI’en. Det er din instruktion eller spørgsmål. Jo bedre prompt, jo bedre svar.

Simpel prompt:

“Hvad er AI?”

Bedre prompt (med kontekst):

“Jeg arbejder i Region Syd med miljøstyringssystemer. Hvordan kan AI hjælpe med at kvalificere ændringsønsker?”

Endnu bedre prompt (med rolle + kontekst):

“Du er en AI-ekspert der hjælper med at kvalificere ændringsønsker. Jeg arbejder i Region Syd med miljøstyringssystemer hvor sagsbehandlere indtaster data om jordforurening. Hvordan kan jeg få bedre input fra forretningen når de laver ændringsønsker?”

Læring: Jo mere kontekst og struktur, jo bedre svar.

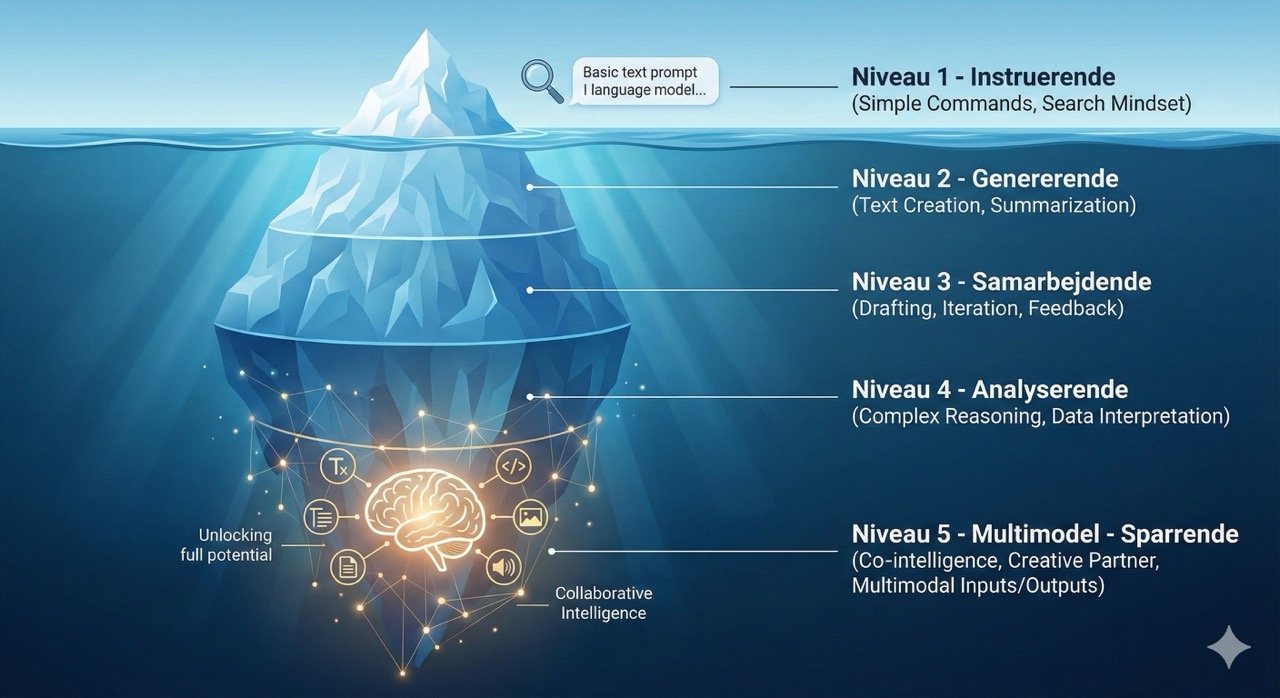

AI Interaktion: Fra Simple Prompts til Avanceret Samarbejde

Billedet nedenfor viser “Iceberg-modellen” for AI-interaktion - fra simple instruktioner til avanceret samarbejde:

De 5 Niveauer:

Niveau 1 - Instruerende (Simple Commands, Search Mindset):

- Basale tekst-prompts

- “Hvad er AI?” eller “Søg efter…”

- Tænk på AI som en søgemaskine

Niveau 2 - Genererende (Text Creation, Summarization):

- Tekst-generering og sammenfatning

- “Skriv en email om…” eller “Opsummer dette dokument”

- AI skaber nyt indhold baseret på input

Niveau 3 - Samarbejdende (Drafting, Iteration, Feedback):

- Udvikling gennem iteration

- “Skriv første udkast, så justerer vi”

- Feedback-loop mellem dig og AI

Niveau 4 - Analyserende (Complex Reasoning, Data Interpretation):

- Kompleks ræsonnering og data-tolkning

- “Analyser denne data og find mønstre”

- AI bruger avanceret logik til analyse

Niveau 5 - Multimodel - Sparrende (Co-intelligence, Creative Partner):

- Multimodal samarbejde (tekst, billeder, kode, audio)

- “Unlocking full potential” - Collaborative Intelligence

- AI som kreativ sparringspartner med fuld potentiale

Hvad betyder det for jer?

- Start med Niveau 1-2 (simple prompts) - det er fint!

- Arbejd mod Niveau 3-4 (iteration og analyse) - det er hvor værdien skabes

- Niveau 5 er målet - AI som kreativ sparringspartner der forstår jeres kontekst

I workshoppen: Vi starter med Niveau 1-2 (simple prompts til one-liners), arbejder mod Niveau 3 (iteration med PPG), og når Niveau 4-5 når I integrerer AI i jeres daglige arbejde.

Praktiske Eksempler - Problematik Først

Eksempel 1: Simpel Prompt (Uden Kontekst)

Prompt:

“Hvad er AI?”

Resultat: Generelt svar baseret på træningsdata - ikke relevant for jeres problem

Eksempel 2: Prompt med Problematik (Bedre)

Prompt:

“Jeg har et problem: Folk sender one-liners når de laver ændringsønsker i GitHub. Eksempel: ‘Statistik/Dashboard. Hvor mange billeder er kommet ind?’ Hvordan kan AI hjælpe mig med at kvalificere disse one-liners?”

Resultat: Mere relevant svar der fokuserer på jeres problem

Eksempel 3: Prompt med Rolle + Problematik (Bedst)

Prompt:

“Du er en AI-ekspert der hjælper med at kvalificere ændringsønsker. Problematik: Folk sender one-liners i GitHub Issues. Eksempel: ‘Statistik/Dashboard. Hvor mange billeder er kommet ind?’ Udviklere kan ikke arbejde med dem. Testmanager forstår ikke hvad der ønskes. Mange ‘ping-pong’ spørgsmål. Kontekst: System: Miljøstyringssystem. Brugere: Sagsbehandlere, miljørådgivere. Formål: Håndtere jordforureningsdata. Hvordan kan jeg bruge AI til at kvalificere one-liners til udviklingsklare specifikationer?”

Resultat: Struktureret svar med fokus på jeres konkrete problematik

Læring: Start med problemet, ikke teknologien. Giv kontekst. Brug rolle-tildeling.

Faldgrupper

❌ Blind Tillid

- Problem: Tror alt AI siger er korrekt

- Løsning: Altid verificer med faglighed

❌ For Abstrakt

- Problem: “Gør det bedre” (for vagt)

- Løsning: “Gør X, Y, Z specifikt” (konkret)

❌ Manglende Kontekst

- Problem: “Kvalificer dette” (uden kontekst)

- Løsning: Giv kontekst om system, brugere, formål

❌ Ikke Verificering

- Problem: Bruger AI’s svar direkte uden tjek

- Løsning: Test, verificer, juster

McKinsey-Princippet: Start med Problemet

“Start med problemet, tænk på teknologien bagefter”

Dette er kerneprincippet i workshoppen. Vi starter ikke med at forklare AI-teknologi, men med jeres problematik:

- Problemet: One-liners i GitHub Issues

- Konsekvenser: “Ping-pong” spørgsmål, forsinket udvikling

- Løsningen: AI kan kvalificere one-liners

- Teknologien: Sprogmodeller og prompts som værktøj

Hvorfor dette princip?

- ✅ Fokus på værdi, ikke teknologi

- ✅ Konkret løsning på jeres problem

- ✅ Lettere at forstå når man ser anvendelsen først

- ✅ Inspiration til at bruge AI i jeres eget arbejde

Eksempel på tilgang:

- ❌ Forkert: “Her er hvad AI er… nu skal I finde ud af hvad I kan bruge det til”

- ✅ Korrekt: “Her er jeres problem… sådan kan AI hjælpe… og sådan virker teknologien”

Konkret om PPG’en - Problematik Først

PPG (Personlig Prompt Guide) er ikke bare en teknisk løsning - den er en procesmæssig forbedring baseret på jeres problematik.

Problematik → Løsning

Problematik:

- One-liners mangler struktur

- Ingen systematisk proces

- Kvaliteten varierer

Løsning med PPG:

- Struktur - PPG’en definerer hvad der skal være i et kvalificeret ændringsønsker

- Proces - PPG’en guides brugeren gennem kvalificeringsprocessen

- Feedback-loop - PPG’en forbedres løbende gennem GitHub versionsstyring

Hvordan det virker:

- Brugeren sender one-liner til AI med PPG aktiv

- AI stiller kvalificerende spørgsmål baseret på PPG’en

- Brugeren svarer

- AI strukturerer output i standardiseret format

- Resultat: Kvalificeret ændringsønsker klar til udvikling

Se også: PPG Guide for detaljeret forklaring

Næste Skridt

Nu hvor du forstår grundlæggende hvad sprogmodeller er og hvordan vi tager udgangspunkt i problematikken:

- Se Change Requests for praktiske eksempler med jeres one-liners

- Se PPG Guide for struktureret tilgang til kvalificering

- Se Del 2: Hands-on for prompt-teknikker og praktiske øvelser

📝 Husk

- Start med problemet, ikke teknologien - McKinsey-princippet

- AI gætter, ikke fakta - verificer altid

- Kontekst er kritisk - jo mere, jo bedre

- Test altid resultaterne - brug faglighed til at validere

- AI er sparringspartner, ikke guru - den hjælper, men erstatter ikke faglighed